ChatGPT robí chyby a čerpá z dezinformačného zdroja

ChatGPT začal využívať obsah z Grokipédie, ale je tu riziko chybných odpovedí.

Podľa skúseností, ktoré popisuje The Guardian, sa to týka novej verzie modelu ChatGPT-5.2. Tá začala vo svojich odpovediach odkazovať na informácie z kontroverznej encyklopédie Grokipedia. Má ísť o slobodnú „Wikipédiu“, avšak prekrúcanie faktov sa len ťažko dá chápať ako sloboda.

Znamená to, že ChatGPT sa môže stať menej dôveryhodným zdrojom najmä pri menej známych alebo citlivých témach. V praxi to znamená, že GPT-5.2 už neodpovedá len na základe tradičných a overených dát, ale do výsledkov sa dostávajú aj časti z Grokipédie.

Podľa testov boli citácie z Grokipédie zaznamenané v 9 z viac ako 12 odpovedí. Týkali sa práve kontroverzných tém z oblasti politiky a histórie.

Nielen ChatGPT robí chyby

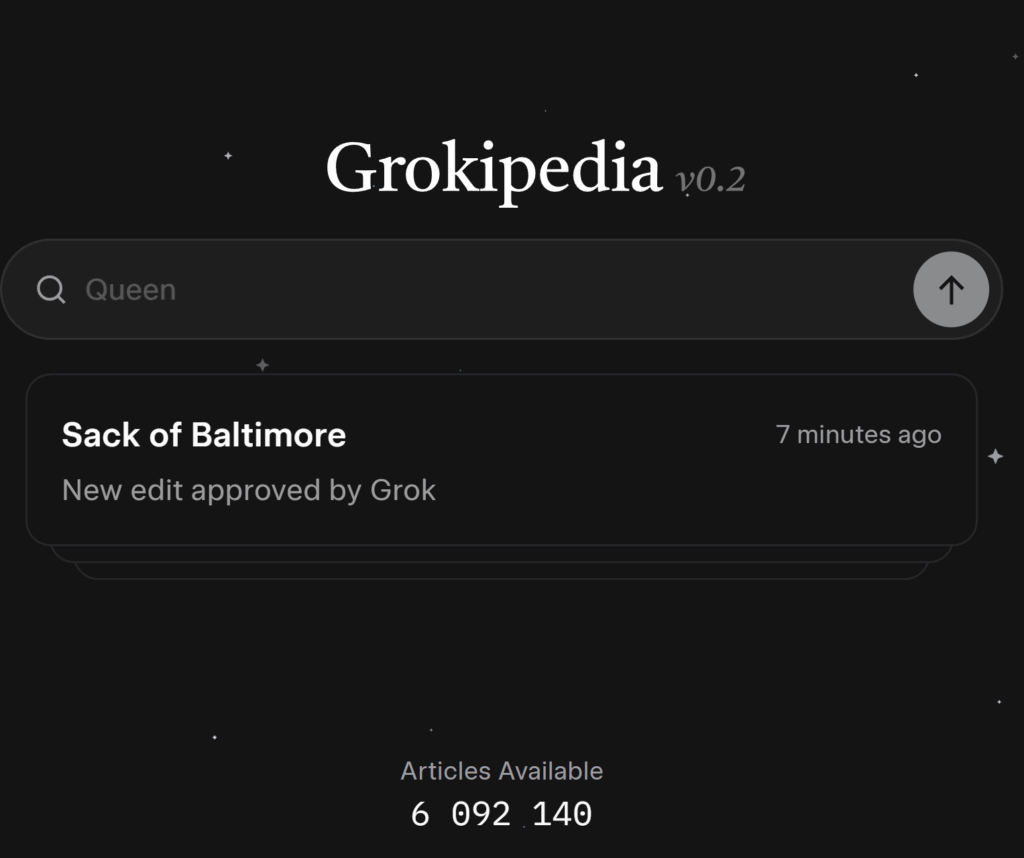

Grokipedia vznikla koncom októbra 2025 a od Wikipédie sa odlišuje v tom, že obsah tejto encyklopédie generuje AI bez úprav zo strany komunity. Kritici upozorňujú, že takýto prístup môže viesť k šíreniu nepresných alebo zaujatých informácií. Problém sa ale podľa doterajších zistení týka aj modelu Claude od Anthropicu.

Využívanie Grokipédie v odpovediach ChatGPT vyvoláva obavy medzi odborníkmi na dezinformácie a etiku. Tí hlasno upozorňujú, že ak AI modely používajú ako zdroj neoverené alebo potenciálne zaujaté texty, ovplyvní to kvalitu textu.

Bežných tém ako je cvičenie či technológie by sa to týkať nemuselo. Čoskoro sa však môžu objaviť rôzne zavádzania aj pri odpovediach na otázky týkajúce sa životosprávy a medicínskych tém.

Zdroj: The Guardian

Prečítajte si aj:

Podobné články

ChatGPT spúšťa reklamy pre dva typy účtov

Poznáme, aké limity má ChatGPT Go

ChatGPT Translate: Prekladajte inteligentnejšie, ako na to?

Aká je najlepšie AI? Tento web vám to prezradí

Praktické tipy, ako využiť AI v kancelárii

Tvoríte AI obrázky? Takýto zložitý príkaz naozaj netreba